Apple Intelligence を使うユーザーが「ビジュアルインテリジェンス(Visual Intelligence)」を体験し始めています。

この AI 認識機能は、カメラやスクリーンに映る内容を理解し、リアルタイムで情報検索、文字翻訳、植物や商品の識別などを行うことができます。

しかし、「カメラコントロールボタンがないと使えない」と思っている人も多いようです。実は、iPhone 15 Pro でもカメラボタンがなくても簡単に使える方法があります。

Apple Intelligenceの有効化手順

「ビジュアルインテリジェンス」を使うには、まず Apple Intelligence を有効にする必要があります。手順は以下の通りです:

- 対応機種を確認:iPhone 15 Pro 以降のモデルであること。

- システム更新:iOS 26.1 以上にアップデートする。

- 言語設定:「日本語」に設定する。

- 機能を有効化:「設定」→「Apple Intelligence と Siri」→「オン」にする。

- 起動方法:通常は「カメラコントロールボタン」を長押しすると「ビジュアルインテリジェンス」が起動します。

初回起動時にはAIモデル(約13GB)がダウンロードされるため、Wi-Fi接続と充電をおすすめします。

画面下部に「Apple Intelligence のサポートコンテンツをダウンロード中」と表示され、これが消えると設定完了です。

iPhone 15 Pro にカメラボタンがない場合の起動方法

iPhone 16 シリーズ以降では専用のカメラコントロールボタンで「ビジュアルインテリジェンス」を長押し起動できますが、iPhone 15 Pro にはボタンがありません。しかし、少し設定すれば同様に使えます。

方法①:アクションボタンに割り当てる

「設定」→「アクションボタン」→「ビジュアルインテリジェンス」を選択。

これで、アクションボタンを長押しするだけで起動可能です。

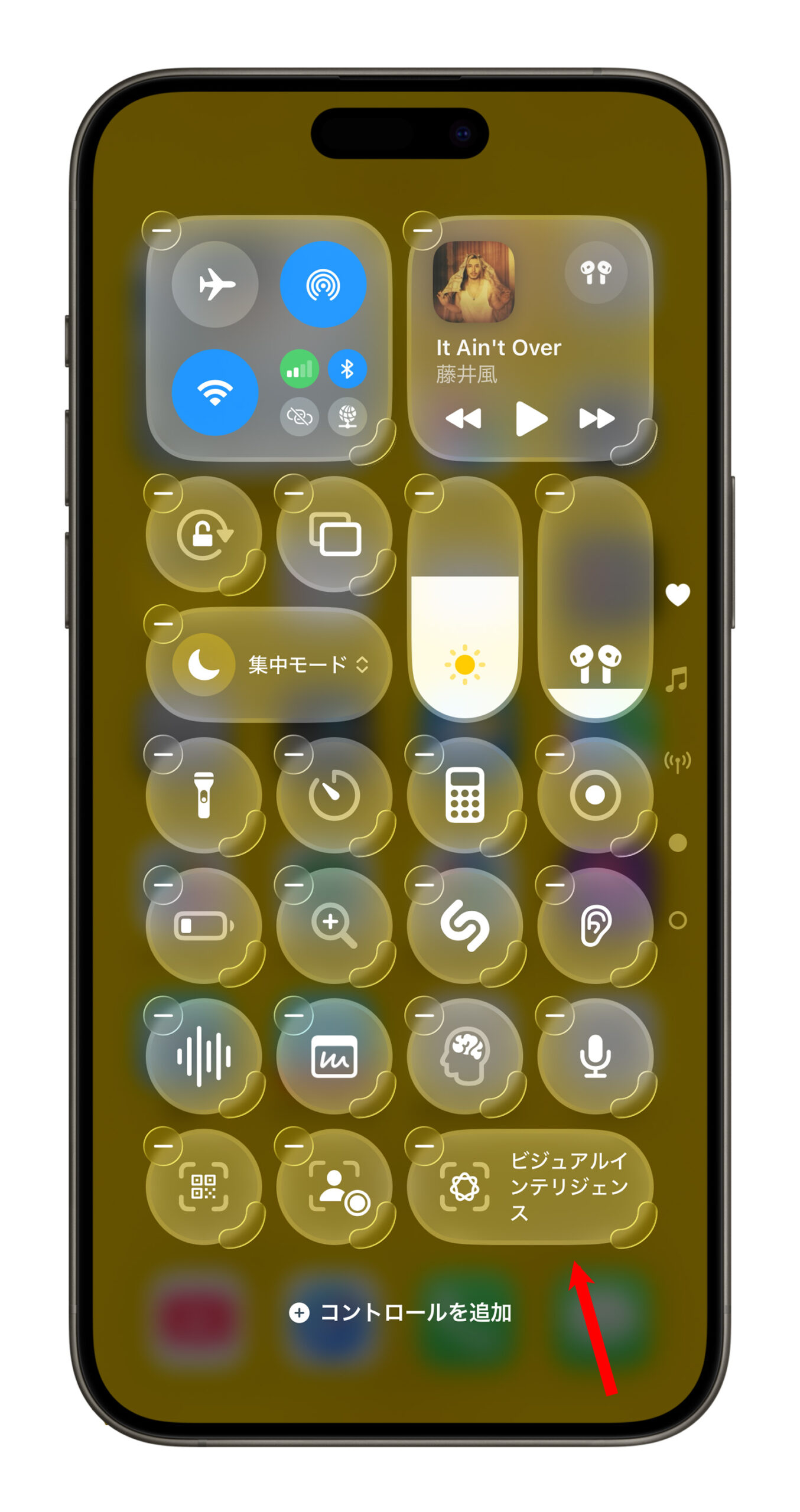

方法②:コントロールセンターに追加

「コントロールセンター」を開き、編集モードで「コントロールを追加」→「ビジュアルインテリジェンス」を追加。

以後、右上からスワイプしアイコンをタップするだけで起動できます。

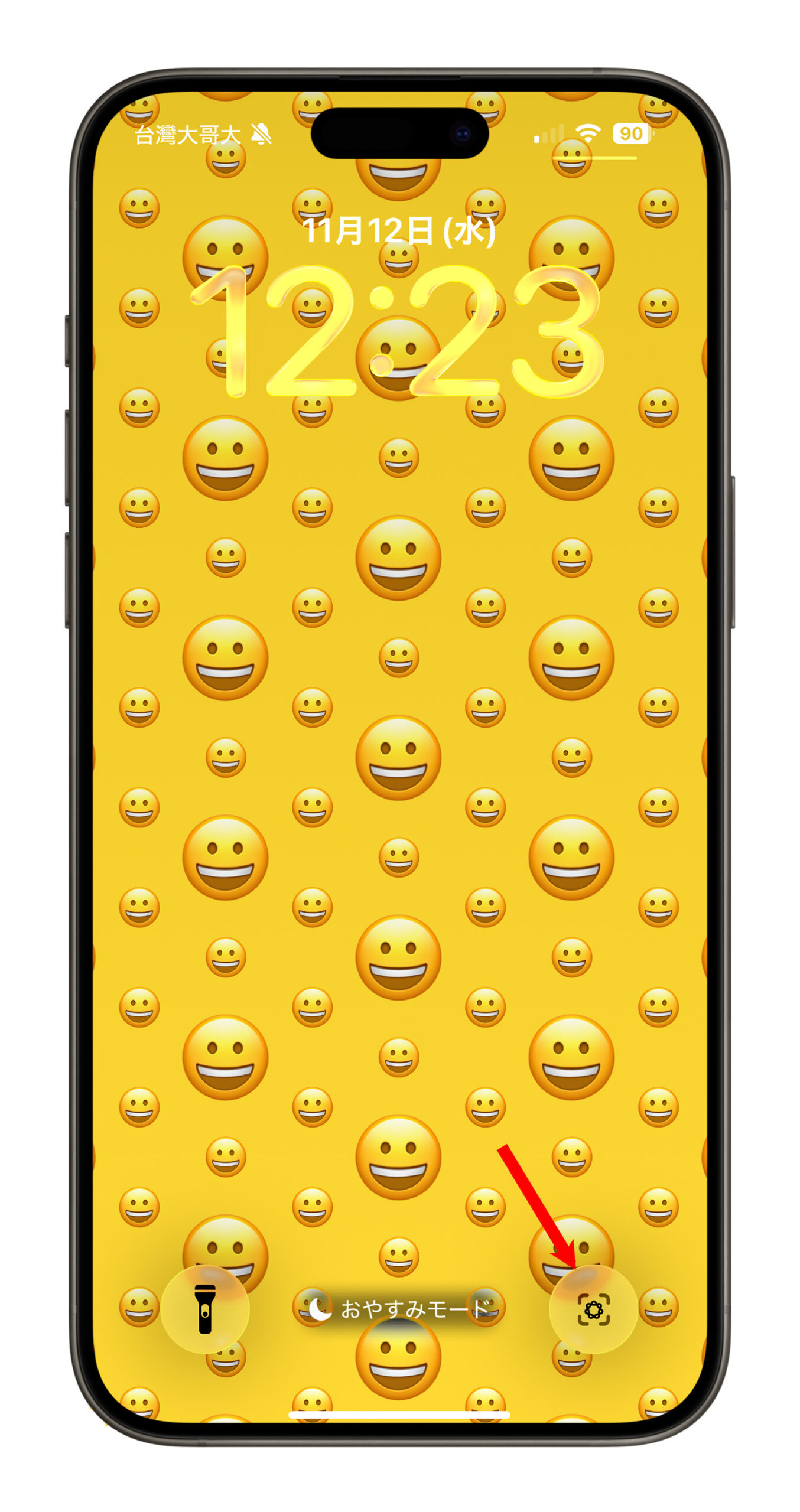

方法③:ロック画面のショートカットに設定

ロック画面下部のショートカットを長押しで編集し、左下または右下の「懐中電灯」や「カメラ」を「ビジュアルインテリジェンス」に変更。

ロック状態でも長押しですぐに起動でき、非常に便利です。

「ビジュアルインテリジェンス」でできること

「Apple Intelligence」のビジュアルインテリジェンスを使うと、情報検索がとても直感的になります。

調べたいものを撮影するだけで、ChatGPTに質問したり、Google画像検索で似た結果を探したりできます。画面に複数の物体がある場合は、認識したい部分を手動で囲むことも可能です。

また、「ライブテキスト(原況文字)」機能とも連携しており、画像や画面内の文字、住所、URL、日付、外国語の説明などを自動で認識。

カレンダーイベントを作成したり、翻訳したりもできます。

スクリーンショットでも同様に使用でき、画像内のイベント日程、商品情報、QRコードなどを一括して抽出できます。アプリを切り替えたり、URLをコピーしたりする必要はありません。

体験してわかる「時短の便利さ」

実際に使ってみると、「ビジュアルインテリジェンス」の魅力は派手さではなく「時間の節約」にあります。海外旅行中の標識翻訳や、見知らぬ場所・資料の整理なども、この機能を使えばすぐに解決。

ChatGPT による検索にはインターネット接続が必要で、認識精度に多少の誤差はあるものの、日常利用には十分実用的です。

つまり、iPhone 15 Pro にカメラボタンがなくても、「アクションボタン」や「コントロールセンター」から起動でき、機能体験に制限はありません。

「撮ってすぐ調べる」という自然な操作で、情報収集がよりスムーズになり、Apple Intelligence の中でも最も試す価値のある機能のひとつとなっています。

もっと読む

iOS 26 に追加された Apple Intelligence の新機能 7 選まとめ